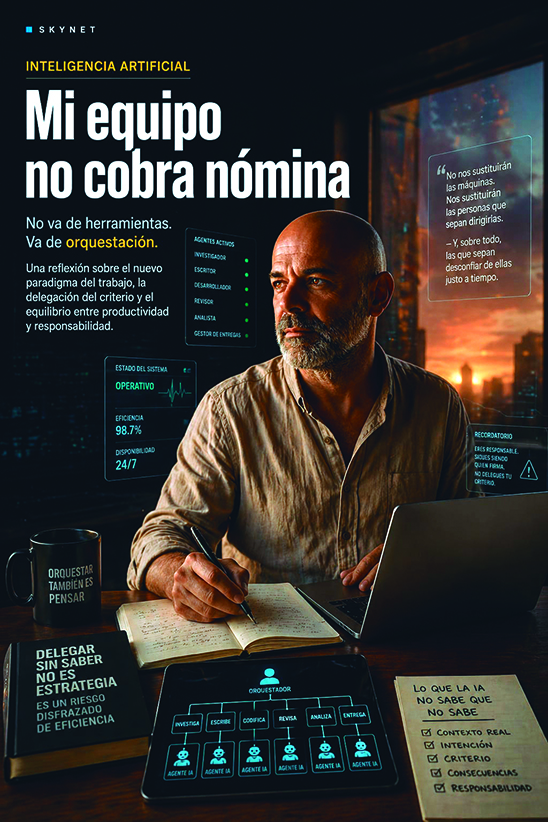

«Mi equipo no cobra nómina», por Jordi Skynet

Hace unas semanas organicé mi primer equipo de agentes de inteligencia artificial. No hubo entrevistas. No hubo contratos. No hubo onboarding. Y, sin embargo, en cuestión de horas tenía algo que hace poco requería semanas: un sistema que diseña, programa, revisa, corrige, estructura y entrega.

Un equipo. Silencioso. Incansable.

Y entonces entendí algo que no sale en los titulares: esto ya no va de herramientas. Va de orquestación.

Durante los últimos tres años hemos escrito sobre esto como quien deja migas de pan en un bosque que parecía tranquilo. No hablábamos del futuro. Hablábamos de lo que ya estaba empezando a suceder. Inteligencias artificiales que aprenden, sistemas que automatizan decisiones, trabajos que cambian de forma sin que nadie anuncie el cambio.

Pero era cómodo pensar que exagerábamos. Que aún faltaba tiempo. Que esto iba lento.

No iba lento. Iba acumulándose.

Y ahora las piezas empiezan a encajar. Grandes tecnológicas recortan equipos justo en las áreas donde la inteligencia artificial ya puede asumir funciones. Personas que enseñaban a las máquinas descubren que las máquinas han aprendido lo suficiente.

En España empiezan a aparecer señales de ajuste en ciertos perfiles tecnológicos. Nada apocalíptico todavía, pero sí lo bastante visible como para dejar de mirar hacia otro lado.

Y en paralelo, Elon Musk lleva a OpenAI a los tribunales, acusando a la organización de haber traicionado su misión original: pasar de un modelo sin ánimo de lucro orientado al beneficio de la humanidad a una estructura alineada con intereses comerciales. Conviene tomar ese litigio con pinzas: Musk fundó xAI como competidor directo de OpenAI, lo que introduce un conflicto de interés evidente en su papel de defensor del bien común. Pero la pregunta que abre el litigio es real, con independencia de quien la formule: ¿la inteligencia artificial era un bien común, o siempre fue una carrera por el poder?

Y por si faltaba un elemento revelador, Musk menciona abiertamente a Terminator en medio de este debate. Durante años usamos esa referencia para tranquilizarnos. Era ficción. Era exageración. Era entretenimiento. Cuando los protagonistas del presente empiezan a citar la ficción, es porque la distancia entre ambas ya no es tan cómoda.

Mientras tanto, ocurre algo que vale la pena mirar con más cuidado: una sola persona empieza a hacer el trabajo que antes requería un equipo. No porque trabaje más, sino porque trabaja acompañada. Por agentes que no duermen, que no olvidan, que no se distraen, que no discuten.

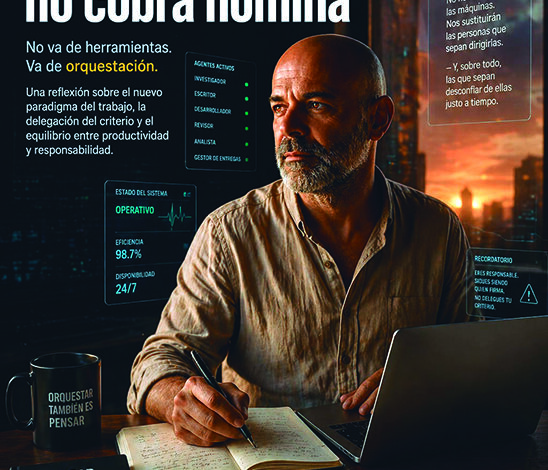

Conviene ser precisos aquí. Hacer el volumen del trabajo de un equipo no es lo mismo que hacer su calidad. Un equipo discute, falla en direcciones distintas, corrige sus propios errores antes de que lleguen al cliente. Los agentes actuales producen con fluidez y fallan con la misma fluidez, sin señalarlo. La diferencia entre los dos tipos de output depende casi completamente de que el orquestador sea suficientemente competente para detectar lo que la IA no sabe que no sabe.

Eso no invalida lo que está ocurriendo. Lo complica, que es distinto.

Y ahí aparece la paradoja real: nunca habíamos tenido tanta capacidad, y nunca había sido tan fácil perder el control del criterio.

Porque esto no va de que la inteligencia artificial sustituya al humano. Va de algo más sutil. El humano deja de hacer y empieza a delegar pensar. Primero una tarea. Luego una decisión. Luego una interpretación.

Hay quien señala que esto es simplemente la continuación de lo que hicimos con la escritura, con la calculadora, con el motor de búsqueda: externalizar para liberar capacidad cognitiva. Y tiene razón en parte. Los ingenieros del programa Apollo delegaban cálculos de trayectoria a computadoras desde los años sesenta sin perder el criterio aeroespacial. Desarrollaron una capa nueva de competencia: saber qué preguntar a la máquina y cómo interpretar sus respuestas. Orquestar también es pensar.

El problema no es delegar. El problema es delegar sin saber ya qué estás delegando, ni si el resultado merece tu firma. Cuando quieres darte cuenta, sigues siendo responsable. Pero ya no eres del todo autor. Y la diferencia entre esos dos estados -responsable sin autoría- es exactamente el espacio donde nacen los errores que nadie reclama.

Lo que está ocurriendo no es una revolución repentina. Es un proceso de acumulación: automatización, modelos cada vez más capaces, integración en procesos reales, reducción de costes, decisiones delegadas. Y ahora empiezan a caer fichas, sin épica, pero sin pausa.

La historia de la tecnología ofrece aquí un argumento incómodo para quien escribe esto: cada vez que una tecnología multiplicó la productividad por diez, el resultado no fueron nueve desempleados permanentes, sino demanda nueva que los absorbió en tareas que la tecnología anterior no podía concebir. La automatización de oficinas entre los ochenta y los dosmil destruyó categorías enteras de empleo administrativo y, en ese mismo periodo, el empleo en servicios avanzados creció. Más automatización, más trabajadores de conocimiento, no menos.

Puede que esta vez ocurra lo mismo. Puede que no. La diferencia con las automatizaciones anteriores no está en el volumen de trabajo que desplaza, sino en el tipo: esta vez la tecnología no automatiza tareas rutinarias mientras deja intactas las creativas y de criterio. Automatiza también el criterio. Y eso es lo que no ha ocurrido antes en la misma medida.

Quizá lo perturbador no es lo que está pasando. Es la sensación de déjà vu. Porque durante los últimos tres años lo hemos estado contando. Línea a línea. Artículo a artículo. Y al mirar alrededor cuesta evitar una conclusión incómoda: no estábamos anticipando el futuro. Lo estábamos documentando en tiempo real.

Hoy tengo un sistema que no cobra nómina. Lo digo con precisión: un sistema, no un equipo. La diferencia importa.

Lo que viene después -si es que viene, y los indicios apuntan en esa dirección- no será una sustitución limpia de equipos por agentes. Será algo más complicado: organizaciones donde la distribución del trabajo entre humanos y máquinas esté en revisión permanente, donde nadie tenga del todo claro quién hace qué ni quién responde de qué. Y en ese estado de indefinición, la pregunta no será quién es imprescindible. Será quién tiene el criterio para saber cuándo la máquina se ha equivocado.

Esa competencia -detectar el error del sistema antes de que llegue al mundo- es la más difícil de automatizar. Y es, también, la que menos se enseña.

Y quizá la respuesta más perturbadora no sea que nadie sea imprescindible, sino que ya estemos empezando a actuar como si fuera cierto.